«Voce dal sen fuggita/ Poi richiamar non vale/ Non si trattien lo strale/ Quando dall’arco uscì» (Ipermestra, Atto II, scena I). Metastasio ci ricorda come le parole abbiano un peso ed una volta pronunciate non possano tornare indietro. Anzi, le parole possono orientare il pensiero, quando creano o trasformano opinioni che si traducono a loro volta in azioni. Per questo, parlare o scrivere con l’intento di informare è un atto di responsabilità. La mente delle persone non funziona come una lavagna dalla quale si può cancellare in ogni momento qualcosa che non quadra più.

La celebre frase di Beaumarchais nel Barbiere di Siviglia «Calunniate, calunniate, qualche cosa resterà» funge all’uopo per indicare come quel qualcosa che poi si vuole cancellare inevitabilmente resta. “Mud sticks” dicono gli inglesi (in italiano suonerebbe più o meno come “il fango resta attaccato”) per sottolineare come le persone continuino a prestare fede a qualcosa di sbagliato, nonostante siano consapevoli della sua infondatezza. È difficile quindi cancellare qualcosa dalla memoria: le tracce di informazioni anche sbagliate che influenzano i nostri pensieri, nonché le nostre azioni, perdurano. Quindi, informazioni rivelatesi poi scorrette, benché riconosciute dalla persona in quanto tali, continuano ad influenzarne il ragionamento. In ragione di una persistenza così tenace, l’esposizione ai fatti, seppur con le migliori intenzioni, non rappresenta necessariamente un’efficace soluzione. Non solo i fatti non hanno sempre il potere di modificare la nostra posizione su un argomento, ma possono indurre paradossalmente le persone a trincerarsi ancor più nelle loro convinzioni (si veda Query, 22, 49-51).

Questi “effetti di contraccolpo” o “ritorni di fiamma” sono riconducibili a dei meccanismi di difesa adoperati per ridurre la dissonanza cognitiva, ovvero quel sentimento “scomodo” che, per esempio, si prova quando si hanno delle convinzioni che entrano in conflitto con le informazioni che si ricevono. Un modo per alleviare questa spiacevole sensazione è quello di rinforzare inconsapevolmente ciò in cui crediamo, convincendoci in qualche modo che non siamo nel torto e rendendoci ancor meno disponibili ad accettare nuove evidenze contrarie. Si distorcono così i fatti, in modo da farli combaciare meglio con le nozioni precostituite o, ancor peggio, si danno per vere acriticamente delle informazioni in realtà sbagliate per sostenere le nostre credenze. Un meccanismo cognitivo, questo, che prende il nome di bias di conferma e che indica come le persone tendano a scegliere selettivamente quelle informazioni che sostengono i propri punti di vista.

Questa è solo una delle ragioni per cui la disinformazione può essere molto difficile da correggere e può avere effetti persistenti nel tempo. Questa breve rassegna si propone di discutere i fattori per mezzo dei quali la disinformazione si propaga nella società contemporanea, per poi analizzare quali sono i meccanismi cognitivi che rendono la disinformazione resistente ai tentativi di correzione, suggerendo infine alcune raccomandazioni sulle strategie di correzione della disinformazione che si sono dimostrate efficaci.

Quello dell’ignoranza è un fenomeno complesso e multiforme. L’ignoranza può riguardare non solo l’incompletezza o la mancanza di conoscenze su un certo argomento da parte del singolo che sceglie di non sapere, ma può essere anche una questione di “incertezza” dovuta ai limiti della scienza su un dato argomento, laddove ad esempio gli esperti non arrivano a capire il funzionamento di sistemi complessi o altamente instabili. C’è poi un altro tipo di ignoranza, questa volta in qualche modo “indotta” e prefabbricata allo scopo di diffondere dubbio e incertezza e di disinformare.

La vastità dei canali attraverso i quali la disinformazione può viaggiare e propagarsi ha portato alla recente costituzione dell’agnotologia, ovvero lo studio dell’ignoranza come fenomeno culturalmente prodotto attraverso azioni intenzionalmente finalizzate a confondere ed ingannare le persone, con il frequente obiettivo finale di vendere un prodotto o un servizio. Casi di evidente disinformazione sono stati ad esempio operati da quelle multinazionali che, per ragioni di profitto, hanno a lungo celato gli effetti dannosi dei combustibili fossili sull’ambiente, generando dubbi sull’esistenza dei cambiamenti climatici e sul ruolo dell’uomo come loro causa primaria. Anche le grandi aziende produttrici di tabacco, per preservare il proprio volume d’affari da capogiro, hanno intossicato per anni l’opinione pubblica con l’idea che non ci fossero delle prove conclusive riguardo la nocività del fumo sulla salute. Glantz e colleghi esaminarono la documentazione trapelata dalle grandi multinazionali del tabacco, dimostrando come queste abbiano usato la strategia di far credere che non vi fosse certezza sui danni da fumo, che questi fossero ancora fonte di dibattito, che gli scienziati e i clinici non avessero un’opinione univoca. Per suffragare l’idea che i rischi da fumo fossero ancora oggetto di studio, hanno ideato campagne pubblicitarie distraenti che hanno goduto di ampi spazi sui mezzi di comunicazione, nonché profumatamente finanziato ricerche che servissero da specchio per le allodole, con la complicità di scienziati consenzienti (e spesso prezzolati)[1]. Recentemente, le multinazionali di tabacco si sono spinte, se possibile, ancora più in là, cercando di mettere le mani sui dati riguardanti il consumo di sigarette tra i giovani[2]. Questi dati, raccolti in via del tutto anonima e confidenziale dall’Università di Stirling, da tempo impegnata nello studio degli effetti delle diverse strategie di marketing sui giovani, rappresentavano evidentemente per i colossi di sigarette una miniera d’oro per pianificare future strategie commerciali vincenti. Evidenti conflitti di interesse che si mischiano addirittura a tentativi di oscurantismo anche nel caso della Coca-Cola, che ha contributo a finanziare delle ricerche sull’obesità e i problemi ad essa legati, con lo scopo di promuovere l’idea secondo cui l’obesità epidemica nelle popolazioni occidentali non sia dovuta all’eccessivo apporto calorico dell’alimentazione, quanto esclusivamente alla mancanza di attività fisica. L’indignazione degli ambienti medici rispetto a questo tentativo di plasmare la ricerca a proprio favore è ben sintetizzata dalle parole di Simon Capewell, che in un’intervista alla BBC ha affermato che «affidare la ricerca sull’obesità alle industrie alimentari è come affidare a Dracula la banca del sangue»[3].

Una questione di dati “massaggiati” per interessi privati si riscontra anche nel caso delle industrie di farmaci omeopatici, che fanno guadagni miliardari vendendo trattamenti il cui effetto è paragonabile al placebo. Ma anche gli stessi governi, in ragione dei loro interessi costituiti, possono essere una fonte di disinformazione. Si pensi, ad esempio, a come il governo americano montò il caso sulle armi di distruzione di massa possedute da Saddam Hussein per motivare l’intervento militare in Iraq. Una mistificazione non infrequente anche nel nostro Paese, in cui l’uso improprio dell’iconografia degli sbarchi clandestini, con navi stracolme che attraccano nei porti o migranti in file chilometriche che attendono un pasto, viene utilizzata per rappresentare il fenomeno dell’immigrazione nel suo complesso, trascurando la stragrande maggioranza di stranieri che giunge in Italia legalmente.

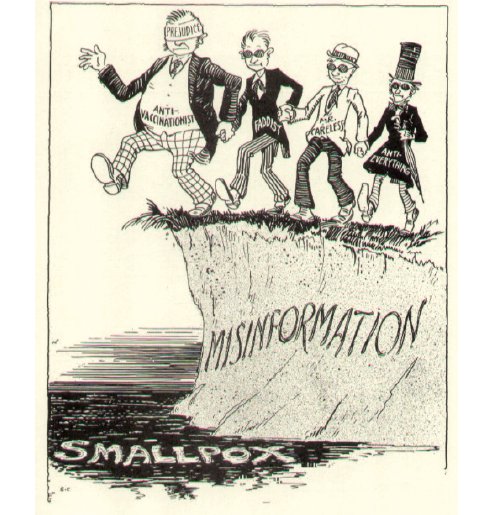

Anche le opere di narrativa ed i film, quando vengono presi alla lettera e non come storie di pura finzione, possono diffondere idee perniciose. È il caso de Lo Stato di paura, il best seller antiecologista dello scrittore americano Michael Crichton, nel quale si sostiene la tesi che la minaccia del surriscaldamento globale sia praticamente inesistente. Il thriller, che ha riscosso grande interesse e successo, è stato addirittura citato dal Senato statunitense come un fondamentale contributo al dibattito sull’origine antropica dei cambiamenti climatici. Molto scalpore ha suscitato anche il film che si spaccia per documentario Vaxxed: From Cover-Up to Catastrophe sul supposto legame tra vaccini e autismo. Il regista è Andrew Wakefield, autore dello studio poi forzatamente ritrattato. Al film è toccata la stessa sorte, essendo stato ritirato dal Tribeca Film Festival a seguito delle molte critiche da parte dei medici e della comunità scientifica.

Sul podio delle fonti disinformative primeggiano indubbiamente i mass media, che fanno spesso un uso strumentale del pluralismo, perseguendo ed enfatizzando il disaccordo anche quando le posizioni degli scienziati, fatte rarissime eccezioni, sono quasi del tutto omogenee e consensuali. Un problema che secondo il comico John Cleese è in parte riconducibile al fatto che troppe volte gli editori televisivi non solo non sanno ciò che fanno, ma non hanno idea che non sanno ciò che fanno, prestando eccessiva ed immotivata fiducia nelle proprie capacità di giudizio[4]. Ne è un esempio lampante ciò che è successo nella puntata del programma televisivo Virus del 12 maggio scorso, andata in onda in prima serata su Rai 2[5]. Il conduttore Nicola Porro ha riproposto il tema delle vaccinazioni nella solita chiave da talk popolare, dando ampio spazio, a difesa di una supposta parità di opinione, a personaggi dello spettacolo che hanno sostenuto posizioni personali ed antiscientifiche, mentre la voce degli esperti sul tema è rimasta pressoché inascoltata. Nel corso della trasmissione sono state fatte delle affermazioni false ed assai perniciose, una su tutte quella di Red Ronnie per cui vaccinare «è assolutamente demenziale». Un servizio di vera e propria disinformazione in cui l’opinione di persone non competenti è stata posta a pari livello di quella ampiamente sostenuta dalla comunità scientifica, come se si potesse fare la scienza sulle opinioni indipendentemente dalle evidenze.

Però, se ci mettiamo nei panni dei produttori di notizie, vi sono delle oggettive difficoltà nel selezionare, tra l’infinità di accadimenti quotidiani, ciò che c’è di vero e nel presentare poi nel modo più corretto queste notizie al grande pubblico. La disinformazione da parte dei mass media può perciò essere operata anche senza alcun intento di ingannare, per esempio in tutti quei casi in cui si susseguono rapidamente le correzioni delle notizie, che si disvelano inevitabilmente a poco a poco, proprio come nella cronaca di una partita di calcio in cui il risultato cambia spesso e se ci fermassimo ad ogni dato punto avremmo un’informazione errata del risultato finale della partita. A titolo d’esempio, un’emittente televisiva riportò tempo fa che una famiglia di quattro persone venne ritrovata morta in casa, la stessa sera in cui aveva mangiato in un ristorante cinese[6]. Pochi giorni dopo, seguì una rettifica che precisava che le tragiche morti erano state provocate in realtà dal malfunzionamento di una caldaia. Dopo qualche tempo, lo sfortunato titolare del ristorante cinese fu costretto comunque a chiudere il locale, nel quale nessuno arrischiava di avventurarsi, perché “non si sa mai”.

L’avvento di Internet e delle nuove tecnologie digitali ha poi modificato profondamente il panorama mediale, diversificatosi in una serie di strumenti che hanno reso ancora più continua e capillare la divulgazione delle notizie al prezzo di un’orizzontalizzazione del sapere, cosicché alcuni credono di poter padroneggiare un argomento dopo qualche ora di ricerche sul web. Internet può anche diventare uno strumento che permette di creare facilmente delle autodiagnosi vagando da un sito web all’altro, arrivando a credere di saperne di più di un professionista. A tal proposito, una vecchia freddura diceva più o meno: “si cura con l’enciclopedia medica e muore per un errore di stampa”. Ecco allora che si possono incontrare persone preoccupatissime, alla ricerca disperata di rimedi per le loro presunte malattie. Non molto tempo fa, uno di noi (SDS) visitò in ambulatorio un signore convinto di aver contratto la malattia delle Montagne Rocciose, una malattia potenzialmente letale caratterizzata da febbre, cefalea ed eruzioni cutanee e provocata dal morso di una zecca che vive solo sulle montagne delle coste pacifiche. Il paradosso era che l’uomo non aveva mai viaggiato. A nulla valsero le rassicurazioni che, non essendo lui mai stato in America, la sua autodiagnosi era quantomeno improbabile. A seguito delle sue ricerche era ormai convinto di una corrispondenza dei sintomi con la malattia in questione e la diagnosi che si era fatto era stata confermata da una discussione che aveva avuto su un blog che combatteva la “medicina ufficiale e i medici che prescrivono farmaci”.

L’esplorazione superficiale del web può quindi dare l’illusione che per conoscere un argomento, che rientri nella politica, nell’attualità o in qualsiasi altro settore, basti interrogare un motore di ricerca e cercare un po’ nell’oceano di informazioni approssimative e fuorvianti che si trovano in rete. Si tratta di una forma di autoinganno comune e nota in psicologia con il nome di “effetto Dunning-Kruger”, dai ricercatori che per primi l’hanno studiata sperimentalmente. Alla sua base vi sarebbe l’incapacità metacognitiva, da parte di individui inesperti in una materia, di riconoscere i propri limiti ed errori ed anzi la tendenza a sopravvalutarsi, credendo di saperla fin troppo lunga. Secondo Dunning siamo tutti degli ignoranti troppo sicuri di noi stessi (“we are all confident idiots”)[7], che non accettano quindi di essere in realtà degli incompetenti.

Anche i social network hanno il loro rovescio della medaglia; difatti, se da un lato offrono un’opportunità di aggregazione, dall’altro possono contribuire ad inasprire la polarizzazione delle opinioni e a creare nicchie di simil-pensiero (si pensi ad esempio ai blog anti-vaccinisti o ad altre forme di ghetti nel mondo virtuale), e possono anche divenire veicolo di idolatria di celebrità di vario tipo (televisive, ma anche personaggi politici o star create dallo stesso web) che parlano al grande pubblico senza avere le competenze necessarie. Una questione che si riconnette al problema più ampio e complesso della credibilità della fonte comunicativa, o meglio della percezione della sua credibilità, nonché del suo potere persuasivo. Se per esempio la fiducia nei confronti della fonte si fonda sulla sua attrattività, e non su una verifica della sua competenza reale o dei dati che porta a sostegno delle sue affermazioni, ecco allora che l’ascoltatore può facilmente venire indotto in errore.

Questo flusso ininterrotto di informazione e disinformazione originato dall’ampia differenziazione dell’attuale panorama mediale ha reso quindi possibile per le persone trovare nuove e diverse fonti che possano supportare il proprio punto di vista precostituito, secondo un fenomeno noto come “esposizione selettiva”, per cui, sempre per evitare il fastidioso fenomeno della dissonanza cognitiva, si evita di venire in contatto con informazioni che sono in contrasto con quelle che già si posseggono, ricercando invece fonti di informazione che possano confermare le opinioni già condivise. Si tendono a scegliere dall’offerta informativa i casi in grado di confermare i nostri pregiudizi, ignorando al contempo quelli che potrebbero invece contraddirli e che susciterebbero dei meccanismi emotivi di difesa.

Proprio le emozioni giocano un ruolo importante nella facilità con la quale la disinformazione riesce a dilagare. L’attivazione emotiva aumenta la tendenza delle persone a tralasciare il controllo della veridicità delle informazioni. Così, hanno una maggiore probabilità di diffondersi le storie che evocano disgusto, paura o felicità, rispetto a storie in qualche modo più “neutre” emotivamente. Come dimostra uno studio di Peters e colleghi, le persone sono più propense a condividere con altri quelle storie che evocano emozioni forti come la felicità o il disgusto, storie che finiscono così per diventare parte del tessuto culturale di una società. Ecco spiegato anche perché ad esempio tra i “disinformatori” più efficaci vi sono quei genitori che credono che il loro figlio si sia ammalato a causa di un vaccino, non solo poiché sono in grado di ingenerare paura ed ansia in altri genitori ma anche perché le loro storie, pur prive di alcun rapporto causa/effetto dimostrabile, vengono presentate e diffuse su larga scala dai mass media come dimostrazioni dei rischi associati ai vaccini. Le emozioni, così come le esperienze, i pregiudizi e le credenze, non sono una buona base per fare informazione ed operare delle scelte individuali e collettive consapevoli.

Gabriel Garcìa Màrquez scriveva nel romanzo Memoria delle mie puttane tristi: «...come i fatti reali si dimenticano, alcuni che non si sono mai prodotti possono anche inserirsi tra i ricordi come se fossero stati». Le persone possono confondere ciò che hanno immaginato o sognato con ciò che realmente è accaduto, ciò che hanno visto con quello che hanno creduto di vedere, ciò che hanno sentito con quello che già ritenevano di sapere, o ciò che ha fatto una persona con quello che ha fatto un’altra. Questi falsi ricordi possono essere causati da errori di memoria relativi al monitoraggio della fonte d’informazione, in quanto, dal momento che l’informazione e la sua fonte possono essere ricordate in maniera separata, ci si può ricordare della suddetta informazione ma non della fonte dalla quale l’abbiamo appresa, finendo per attribuirla ad una fonte sbagliata (che ha trattato lo stesso tema, addirittura sostenendo il contrario); per esempio possiamo credere erroneamente che sia l’Organizzazione Mondiale della Sanità ad allertare sui rischi dei vaccini.

Abbiamo visto come il fenomeno della resistenza alle smentite metta seriamente alla prova la premessa secondo cui l’uomo è fondamentalmente un essere razionale. D’altronde, dal momento che la nostra memoria opera secondo dei processi ricostruttivi degli eventi, non possiamo riporvi una fiducia incondizionata (si veda Query, 4, 30-34). Ma se le informazioni di cui disponiamo si rivelano, per qualsiasi ragione, imprecise o sbagliate, perché ci ostiniamo a credervi? Per rispondere a questa domanda possono essere chiamati in causa diversi meccanismi o bias cognitivi. Anzitutto, rispetto alla complessità del mondo, risulta molto difficile per le persone abbandonare l’illusione del controllo. Per ridurre o quantomeno controllare l’incertezza, le persone cedono all’esigenza di ricercare chiarimenti e di conferire una spiegazione causale agli eventi, anche quando non vi sono dei nessi di causazione evidenti fra un evento A ed un evento B. Così, si possono giustificare schemi di causalità inesistenti, facendo delle previsioni estreme con un ottimismo o pessimismo ingiustificati. Si pensi, ad esempio, alla storia della maledizione della copertina di Sports Illustrated[8], secondo la quale l’atleta o la squadra sportiva che conquistano la copertina del celebre magazine sarebbero poi destinati all’insuccesso, che si può manifestare con una serie di cattivi risultati, infortuni, e così via. Si tratta di una leggenda metropolitana che può essere spiegata dalla cosiddetta regressione verso la media; difatti, a finire sulla copertina è in realtà chi ha conseguito delle prestazioni del tutto eccezionali e che, in quanto tali, saranno prevedibilmente seguite da performance “peggiori”, cioè che si avvicineranno alla media.

La ricerca di una causalità sottostante avviene specialmente rispetto ad avvenimenti insoliti o negativi, per evitare in qualche modo che si ripetano. Ed in quei casi in cui le informazioni a disposizione circa un evento sono ambigue, contraddittorie o non immediatamente decifrabili, il ricorso alle spiegazioni fornite dai miti e alle leggende popolari diventa particolarmente rassicurante. Appellarsi alle proprie conoscenze pregresse e pregiudiziali permette di dare un senso, anche se imperfetto o incompleto, a degli eventi che sarebbero altrimenti di difficile comprensione. Si pensi all’aura di mistero che circonda un disturbo assai complesso come l’autismo, rispetto alla cui reale eziologia la comunità scientifica non è giunta ancora alla formulazione di teorie univoche e definitive. Ciò ha dato ampio spazio nel corso del tempo alla proliferazione di ipotesi estremamente eterogenee quanto scientificamente infondate sulle sue cause, come l’ampiamente smentita credenza secondo la quale i vaccini abbiano un ruolo in merito. Nonostante le ripetute smentite da più parti e gli accorati appelli a partecipare ai programmi di immunizzazione preventiva, questa falsa credenza ha tutt’oggi ancora un largo seguito in parte perché, in assenza di una spiegazione causale alternativa soddisfacente, le persone tendono a ripiegare sulla spiegazione fornita dal mito, per quanto evidentemente errata. Il problema risiede nel fatto che quando una persona apprende un’informazione scorretta, costruisce una sorta di modello mentale, ovvero una storia radicata nella propria mente, con il mito che ne fornisce una spiegazione. Perciò, quando si tenta di comunicarle che ciò in cui crede è falso, risulta difficile per la persona sorreggere la validità di un modello con un “buco”, una lacuna mentale. Così, in assenza di una spiegazione migliore, si finisce per preferire un modello pre-esistente ed errato rispetto ad uno corretto ma incompleto. La questione diventa ancor più complessa se si considera che, una volta che abbiamo una teoria, una certa visione del mondo che in qualche modo ci soddisfa e in cui crediamo, tendiamo sistematicamente ad esaminare i fatti attraverso di essa e a ricercare puntualmente conferme a questa teoria. Come ci ricorda un antico detto: due terzi di quello che vediamo è dietro i nostri occhi. Sarà la nostra visione del mondo a determinare quindi ciò che osserviamo, tralasciando tutto il resto che in qualche modo risulta non conforme rispetto alle nostre convinzioni.

Per elaborare le informazioni velocemente ricorriamo ad una serie di euristiche, ovvero a delle scorciatoie mentali che consentono un notevole risparmio delle nostre limitate risorse cognitive. Tali meccanismi cognitivi si caratterizzano per la loro parziale automaticità, per cui si è spesso inconsapevoli di metterli in atto, nonché per la loro profonda radicazione, in quanto modificarli richiede volontà, impegno e tempo, proprio perché si tratta di schemi di ragionamento interiorizzati. Ad esempio, ogni qual volta si è posti di fronte ad una nuova informazione, ci si chiede come questa si incastri con ciò in cui crediamo. Se l’informazione non risulta coerente con la nostra visione del mondo, e se non siamo motivati ad un’analisi approfondita della questione, essa tenderà a venir percepita come sbagliata proprio in quanto incoerente, ed avrà altresì una minore probabilità di essere accettata come vera. Il paragone non viene operato solo rispetto a se stessi, ma anche rispetto a quello che si pensa credano le altre persone. Essendo difatti l’uniformità al proprio gruppo di riferimento una pressione molto forte per l’uomo, l’informazione in questione verrà giudicata tanto più valida quanto più si avvicina alla voce del coro.

Contrastare efficacemente la disinformazione è un compito tutt’altro che semplice. Una convinzione assai diffusa quanto sbagliata è che, per rimuovere l’influenza dei miti, basti riempire la testa della gente con il maggior numero possibile di informazioni. Difatti, secondo il “modello del deficit di informazione”, il nostro cervello non sarebbe altro che una sorta di disco rigido che accumula dati. Di conseguenza, le convinzioni errate delle persone sarebbero dovute unicamente ad una mancanza di informazioni corrette che, se opportunamente comunicate, garantirebbero la rimozione dell’influenza della falsa credenza in questione. Tuttavia, quest’approccio si è rivelato evidentemente limitato dal momento che numerosi studi dimostrano come, una volta che l’informazione sbagliata è stata immagazzinata, non si può semplicemente spazzarla via. Quindi, per sfatare miti e false credenze e trasmettere delle informazioni in modo efficace bisogna prestare attenzione non solo a cosa pensano le persone ma anche a come pensano, comprendendo come queste elaborano le informazioni, nonché come le modificano in ragione delle conoscenze pre-esistenti e della propria visione del mondo.

Ad oggi, le strategie che si sono rivelate più efficaci in materia di demistificazione sono essenzialmente tre. La prima implica l’utilizzo di espliciti avvertimenti (del tipo: “attenzione, potresti essere tratto in inganno”), che segnalino quindi la presentazione imminente di un’informazione scorretta. Mettere in guardia rispetto all’infondatezza dell’informazione che si sta per analizzare consente infatti di indurre un temporaneo stato di scetticismo che permette di discriminare più efficacemente ciò che è vero da ciò che è falso. Tuttavia, questi avvertimenti dovrebbero essere forniti prima dell’informazione fallace in questione, cosa non sempre realizzabile al di fuori del laboratorio, nella vita quotidiana. Alternativamente, ripetere più volte che l’informazione è sbagliata può talvolta ridurre la fiducia che le persone ripongono in essa. Anche questa è tuttavia un’operazione assai delicata perché esagerare nelle contro-argomentazioni, fornendo troppi dati o spiegazioni esageratamente complicate, può talvolta sortire l’effetto opposto e rafforzare le credenze erronee iniziali. Un approccio forse più efficace consiste nel fornire una spiegazione alternativa alle lacune lasciate dal mito, dando altresì ragione del motivo per il quale l’informazione sbagliata sia stata fornita in prima istanza. Tuttavia, anche questo approccio non è sempre praticabile in quanto vi sono eventi che non hanno una spiegazione causale evidente ed univoca.

In mancanza di una strategia certa che possa assicurare l’eradicazione dell’influenza della disinformazione, il principio che dovrebbe comunque guidare l’opera di demistificazione è senza dubbio quello di non rendere le cose peggiori, evitando i vari possibili effetti negativi della comunicazione. Ad esempio, un buon comunicatore sa che i suoi tentativi di correggere credenze profondamente radicate, per quanto ben intenzionati e formalmente corretti, sono destinati a fallire fin dall’inizio se comincia con l’informare le persone che sono in errore. La conseguenza più probabile di una simile condotta sarà un atteggiamento difensivo e di chiusura di fronte alle argomentazioni proposte. Una strategia più promettente nel far recedere qualcuno dalle sue convinzioni risiede invece nel presentare, ove possibile, il messaggio che si vuole trasmettere cercando di renderlo meno minaccioso rispetto alla visione del mondo degli interlocutori ed abbinandolo a momenti di cosiddetta auto-affermazione. In tal modo, questi avranno la possibilità di esprimere la propria visione del mondo e di sentirsi a proprio agio con essa, cosa che farà apparire anche la presentazione di contro-argomentazioni come meno minacciosa. Uno studio di Cohen e colleghi ha dimostrato come la resistenza ad accettare visioni diverse dalle proprie da parte di persone con opinioni politiche molto radicate possa essere allentata allorquando si offre loro l’opportunità di spiegare perché una determinata caratteristica personale o comportamento è così importante per loro. Così, le persone non sentiranno la propria immagine di sé così intaccata e saranno più ricettive verso contro-argomenti che altrimenti potrebbero minacciare e paradossalmente rafforzare le loro credenze.

Oltre alla necessità di prendere in considerazione la visione del mondo della persona e le sue convinzioni più radicate, un’efficace demistificazione richiede di enfatizzare unicamente i fatti che si vogliono comunicare ed evitare di menzionare il mito mentre si cerca di correggerlo, evitando il cosiddetto “ritorno di fiamma di familiarità” ingenerato dall’inutile ripetizione dei miti, che non fa che renderli più familiari ed immediatamente accessibili nella mente delle persone. Laddove questo non fosse possibile, ci si dovrebbe quantomeno focalizzare prioritariamente sui fatti piuttosto che sul mito, comunicandoli nel titolo e rafforzandoli via via nel corso del testo, insieme alle spiegazioni di come il mito possa trarre in inganno. Altresì, è bene preferire un linguaggio semplice, non sensazionalistico e che preveda frasi brevi, dirette, nonché accompagnate, ove possibile, da grafici che illustrino meglio i vari punti.

La varietà di queste raccomandazioni fa intendere come l’opera di demistificazione sia una sfida complessa, ma senza dubbio necessaria dal momento che le società democratiche debbono basare le loro decisioni su informazioni accurate. «Guai – scriveva nel 1982 il fisico Giuliano Toraldo di Francia – se limitandoci a soddisfare curiosità abbastanza superficiali non riusciamo a integrare la scienza nel vivo del tessuto culturale della società italiana»[9].

La celebre frase di Beaumarchais nel Barbiere di Siviglia «Calunniate, calunniate, qualche cosa resterà» funge all’uopo per indicare come quel qualcosa che poi si vuole cancellare inevitabilmente resta. “Mud sticks” dicono gli inglesi (in italiano suonerebbe più o meno come “il fango resta attaccato”) per sottolineare come le persone continuino a prestare fede a qualcosa di sbagliato, nonostante siano consapevoli della sua infondatezza. È difficile quindi cancellare qualcosa dalla memoria: le tracce di informazioni anche sbagliate che influenzano i nostri pensieri, nonché le nostre azioni, perdurano. Quindi, informazioni rivelatesi poi scorrette, benché riconosciute dalla persona in quanto tali, continuano ad influenzarne il ragionamento. In ragione di una persistenza così tenace, l’esposizione ai fatti, seppur con le migliori intenzioni, non rappresenta necessariamente un’efficace soluzione. Non solo i fatti non hanno sempre il potere di modificare la nostra posizione su un argomento, ma possono indurre paradossalmente le persone a trincerarsi ancor più nelle loro convinzioni (si veda Query, 22, 49-51).

Questi “effetti di contraccolpo” o “ritorni di fiamma” sono riconducibili a dei meccanismi di difesa adoperati per ridurre la dissonanza cognitiva, ovvero quel sentimento “scomodo” che, per esempio, si prova quando si hanno delle convinzioni che entrano in conflitto con le informazioni che si ricevono. Un modo per alleviare questa spiacevole sensazione è quello di rinforzare inconsapevolmente ciò in cui crediamo, convincendoci in qualche modo che non siamo nel torto e rendendoci ancor meno disponibili ad accettare nuove evidenze contrarie. Si distorcono così i fatti, in modo da farli combaciare meglio con le nozioni precostituite o, ancor peggio, si danno per vere acriticamente delle informazioni in realtà sbagliate per sostenere le nostre credenze. Un meccanismo cognitivo, questo, che prende il nome di bias di conferma e che indica come le persone tendano a scegliere selettivamente quelle informazioni che sostengono i propri punti di vista.

Questa è solo una delle ragioni per cui la disinformazione può essere molto difficile da correggere e può avere effetti persistenti nel tempo. Questa breve rassegna si propone di discutere i fattori per mezzo dei quali la disinformazione si propaga nella società contemporanea, per poi analizzare quali sono i meccanismi cognitivi che rendono la disinformazione resistente ai tentativi di correzione, suggerendo infine alcune raccomandazioni sulle strategie di correzione della disinformazione che si sono dimostrate efficaci.

Le possibili fonti di disinformazione

Quello dell’ignoranza è un fenomeno complesso e multiforme. L’ignoranza può riguardare non solo l’incompletezza o la mancanza di conoscenze su un certo argomento da parte del singolo che sceglie di non sapere, ma può essere anche una questione di “incertezza” dovuta ai limiti della scienza su un dato argomento, laddove ad esempio gli esperti non arrivano a capire il funzionamento di sistemi complessi o altamente instabili. C’è poi un altro tipo di ignoranza, questa volta in qualche modo “indotta” e prefabbricata allo scopo di diffondere dubbio e incertezza e di disinformare.

La vastità dei canali attraverso i quali la disinformazione può viaggiare e propagarsi ha portato alla recente costituzione dell’agnotologia, ovvero lo studio dell’ignoranza come fenomeno culturalmente prodotto attraverso azioni intenzionalmente finalizzate a confondere ed ingannare le persone, con il frequente obiettivo finale di vendere un prodotto o un servizio. Casi di evidente disinformazione sono stati ad esempio operati da quelle multinazionali che, per ragioni di profitto, hanno a lungo celato gli effetti dannosi dei combustibili fossili sull’ambiente, generando dubbi sull’esistenza dei cambiamenti climatici e sul ruolo dell’uomo come loro causa primaria. Anche le grandi aziende produttrici di tabacco, per preservare il proprio volume d’affari da capogiro, hanno intossicato per anni l’opinione pubblica con l’idea che non ci fossero delle prove conclusive riguardo la nocività del fumo sulla salute. Glantz e colleghi esaminarono la documentazione trapelata dalle grandi multinazionali del tabacco, dimostrando come queste abbiano usato la strategia di far credere che non vi fosse certezza sui danni da fumo, che questi fossero ancora fonte di dibattito, che gli scienziati e i clinici non avessero un’opinione univoca. Per suffragare l’idea che i rischi da fumo fossero ancora oggetto di studio, hanno ideato campagne pubblicitarie distraenti che hanno goduto di ampi spazi sui mezzi di comunicazione, nonché profumatamente finanziato ricerche che servissero da specchio per le allodole, con la complicità di scienziati consenzienti (e spesso prezzolati)[1]. Recentemente, le multinazionali di tabacco si sono spinte, se possibile, ancora più in là, cercando di mettere le mani sui dati riguardanti il consumo di sigarette tra i giovani[2]. Questi dati, raccolti in via del tutto anonima e confidenziale dall’Università di Stirling, da tempo impegnata nello studio degli effetti delle diverse strategie di marketing sui giovani, rappresentavano evidentemente per i colossi di sigarette una miniera d’oro per pianificare future strategie commerciali vincenti. Evidenti conflitti di interesse che si mischiano addirittura a tentativi di oscurantismo anche nel caso della Coca-Cola, che ha contributo a finanziare delle ricerche sull’obesità e i problemi ad essa legati, con lo scopo di promuovere l’idea secondo cui l’obesità epidemica nelle popolazioni occidentali non sia dovuta all’eccessivo apporto calorico dell’alimentazione, quanto esclusivamente alla mancanza di attività fisica. L’indignazione degli ambienti medici rispetto a questo tentativo di plasmare la ricerca a proprio favore è ben sintetizzata dalle parole di Simon Capewell, che in un’intervista alla BBC ha affermato che «affidare la ricerca sull’obesità alle industrie alimentari è come affidare a Dracula la banca del sangue»[3].

Una questione di dati “massaggiati” per interessi privati si riscontra anche nel caso delle industrie di farmaci omeopatici, che fanno guadagni miliardari vendendo trattamenti il cui effetto è paragonabile al placebo. Ma anche gli stessi governi, in ragione dei loro interessi costituiti, possono essere una fonte di disinformazione. Si pensi, ad esempio, a come il governo americano montò il caso sulle armi di distruzione di massa possedute da Saddam Hussein per motivare l’intervento militare in Iraq. Una mistificazione non infrequente anche nel nostro Paese, in cui l’uso improprio dell’iconografia degli sbarchi clandestini, con navi stracolme che attraccano nei porti o migranti in file chilometriche che attendono un pasto, viene utilizzata per rappresentare il fenomeno dell’immigrazione nel suo complesso, trascurando la stragrande maggioranza di stranieri che giunge in Italia legalmente.

Anche le opere di narrativa ed i film, quando vengono presi alla lettera e non come storie di pura finzione, possono diffondere idee perniciose. È il caso de Lo Stato di paura, il best seller antiecologista dello scrittore americano Michael Crichton, nel quale si sostiene la tesi che la minaccia del surriscaldamento globale sia praticamente inesistente. Il thriller, che ha riscosso grande interesse e successo, è stato addirittura citato dal Senato statunitense come un fondamentale contributo al dibattito sull’origine antropica dei cambiamenti climatici. Molto scalpore ha suscitato anche il film che si spaccia per documentario Vaxxed: From Cover-Up to Catastrophe sul supposto legame tra vaccini e autismo. Il regista è Andrew Wakefield, autore dello studio poi forzatamente ritrattato. Al film è toccata la stessa sorte, essendo stato ritirato dal Tribeca Film Festival a seguito delle molte critiche da parte dei medici e della comunità scientifica.

Sul podio delle fonti disinformative primeggiano indubbiamente i mass media, che fanno spesso un uso strumentale del pluralismo, perseguendo ed enfatizzando il disaccordo anche quando le posizioni degli scienziati, fatte rarissime eccezioni, sono quasi del tutto omogenee e consensuali. Un problema che secondo il comico John Cleese è in parte riconducibile al fatto che troppe volte gli editori televisivi non solo non sanno ciò che fanno, ma non hanno idea che non sanno ciò che fanno, prestando eccessiva ed immotivata fiducia nelle proprie capacità di giudizio[4]. Ne è un esempio lampante ciò che è successo nella puntata del programma televisivo Virus del 12 maggio scorso, andata in onda in prima serata su Rai 2[5]. Il conduttore Nicola Porro ha riproposto il tema delle vaccinazioni nella solita chiave da talk popolare, dando ampio spazio, a difesa di una supposta parità di opinione, a personaggi dello spettacolo che hanno sostenuto posizioni personali ed antiscientifiche, mentre la voce degli esperti sul tema è rimasta pressoché inascoltata. Nel corso della trasmissione sono state fatte delle affermazioni false ed assai perniciose, una su tutte quella di Red Ronnie per cui vaccinare «è assolutamente demenziale». Un servizio di vera e propria disinformazione in cui l’opinione di persone non competenti è stata posta a pari livello di quella ampiamente sostenuta dalla comunità scientifica, come se si potesse fare la scienza sulle opinioni indipendentemente dalle evidenze.

Però, se ci mettiamo nei panni dei produttori di notizie, vi sono delle oggettive difficoltà nel selezionare, tra l’infinità di accadimenti quotidiani, ciò che c’è di vero e nel presentare poi nel modo più corretto queste notizie al grande pubblico. La disinformazione da parte dei mass media può perciò essere operata anche senza alcun intento di ingannare, per esempio in tutti quei casi in cui si susseguono rapidamente le correzioni delle notizie, che si disvelano inevitabilmente a poco a poco, proprio come nella cronaca di una partita di calcio in cui il risultato cambia spesso e se ci fermassimo ad ogni dato punto avremmo un’informazione errata del risultato finale della partita. A titolo d’esempio, un’emittente televisiva riportò tempo fa che una famiglia di quattro persone venne ritrovata morta in casa, la stessa sera in cui aveva mangiato in un ristorante cinese[6]. Pochi giorni dopo, seguì una rettifica che precisava che le tragiche morti erano state provocate in realtà dal malfunzionamento di una caldaia. Dopo qualche tempo, lo sfortunato titolare del ristorante cinese fu costretto comunque a chiudere il locale, nel quale nessuno arrischiava di avventurarsi, perché “non si sa mai”.

L’avvento di Internet e delle nuove tecnologie digitali ha poi modificato profondamente il panorama mediale, diversificatosi in una serie di strumenti che hanno reso ancora più continua e capillare la divulgazione delle notizie al prezzo di un’orizzontalizzazione del sapere, cosicché alcuni credono di poter padroneggiare un argomento dopo qualche ora di ricerche sul web. Internet può anche diventare uno strumento che permette di creare facilmente delle autodiagnosi vagando da un sito web all’altro, arrivando a credere di saperne di più di un professionista. A tal proposito, una vecchia freddura diceva più o meno: “si cura con l’enciclopedia medica e muore per un errore di stampa”. Ecco allora che si possono incontrare persone preoccupatissime, alla ricerca disperata di rimedi per le loro presunte malattie. Non molto tempo fa, uno di noi (SDS) visitò in ambulatorio un signore convinto di aver contratto la malattia delle Montagne Rocciose, una malattia potenzialmente letale caratterizzata da febbre, cefalea ed eruzioni cutanee e provocata dal morso di una zecca che vive solo sulle montagne delle coste pacifiche. Il paradosso era che l’uomo non aveva mai viaggiato. A nulla valsero le rassicurazioni che, non essendo lui mai stato in America, la sua autodiagnosi era quantomeno improbabile. A seguito delle sue ricerche era ormai convinto di una corrispondenza dei sintomi con la malattia in questione e la diagnosi che si era fatto era stata confermata da una discussione che aveva avuto su un blog che combatteva la “medicina ufficiale e i medici che prescrivono farmaci”.

L’esplorazione superficiale del web può quindi dare l’illusione che per conoscere un argomento, che rientri nella politica, nell’attualità o in qualsiasi altro settore, basti interrogare un motore di ricerca e cercare un po’ nell’oceano di informazioni approssimative e fuorvianti che si trovano in rete. Si tratta di una forma di autoinganno comune e nota in psicologia con il nome di “effetto Dunning-Kruger”, dai ricercatori che per primi l’hanno studiata sperimentalmente. Alla sua base vi sarebbe l’incapacità metacognitiva, da parte di individui inesperti in una materia, di riconoscere i propri limiti ed errori ed anzi la tendenza a sopravvalutarsi, credendo di saperla fin troppo lunga. Secondo Dunning siamo tutti degli ignoranti troppo sicuri di noi stessi (“we are all confident idiots”)[7], che non accettano quindi di essere in realtà degli incompetenti.

Anche i social network hanno il loro rovescio della medaglia; difatti, se da un lato offrono un’opportunità di aggregazione, dall’altro possono contribuire ad inasprire la polarizzazione delle opinioni e a creare nicchie di simil-pensiero (si pensi ad esempio ai blog anti-vaccinisti o ad altre forme di ghetti nel mondo virtuale), e possono anche divenire veicolo di idolatria di celebrità di vario tipo (televisive, ma anche personaggi politici o star create dallo stesso web) che parlano al grande pubblico senza avere le competenze necessarie. Una questione che si riconnette al problema più ampio e complesso della credibilità della fonte comunicativa, o meglio della percezione della sua credibilità, nonché del suo potere persuasivo. Se per esempio la fiducia nei confronti della fonte si fonda sulla sua attrattività, e non su una verifica della sua competenza reale o dei dati che porta a sostegno delle sue affermazioni, ecco allora che l’ascoltatore può facilmente venire indotto in errore.

Questo flusso ininterrotto di informazione e disinformazione originato dall’ampia differenziazione dell’attuale panorama mediale ha reso quindi possibile per le persone trovare nuove e diverse fonti che possano supportare il proprio punto di vista precostituito, secondo un fenomeno noto come “esposizione selettiva”, per cui, sempre per evitare il fastidioso fenomeno della dissonanza cognitiva, si evita di venire in contatto con informazioni che sono in contrasto con quelle che già si posseggono, ricercando invece fonti di informazione che possano confermare le opinioni già condivise. Si tendono a scegliere dall’offerta informativa i casi in grado di confermare i nostri pregiudizi, ignorando al contempo quelli che potrebbero invece contraddirli e che susciterebbero dei meccanismi emotivi di difesa.

Proprio le emozioni giocano un ruolo importante nella facilità con la quale la disinformazione riesce a dilagare. L’attivazione emotiva aumenta la tendenza delle persone a tralasciare il controllo della veridicità delle informazioni. Così, hanno una maggiore probabilità di diffondersi le storie che evocano disgusto, paura o felicità, rispetto a storie in qualche modo più “neutre” emotivamente. Come dimostra uno studio di Peters e colleghi, le persone sono più propense a condividere con altri quelle storie che evocano emozioni forti come la felicità o il disgusto, storie che finiscono così per diventare parte del tessuto culturale di una società. Ecco spiegato anche perché ad esempio tra i “disinformatori” più efficaci vi sono quei genitori che credono che il loro figlio si sia ammalato a causa di un vaccino, non solo poiché sono in grado di ingenerare paura ed ansia in altri genitori ma anche perché le loro storie, pur prive di alcun rapporto causa/effetto dimostrabile, vengono presentate e diffuse su larga scala dai mass media come dimostrazioni dei rischi associati ai vaccini. Le emozioni, così come le esperienze, i pregiudizi e le credenze, non sono una buona base per fare informazione ed operare delle scelte individuali e collettive consapevoli.

Meccanismi cognitivi alla base della disinformazione

Gabriel Garcìa Màrquez scriveva nel romanzo Memoria delle mie puttane tristi: «...come i fatti reali si dimenticano, alcuni che non si sono mai prodotti possono anche inserirsi tra i ricordi come se fossero stati». Le persone possono confondere ciò che hanno immaginato o sognato con ciò che realmente è accaduto, ciò che hanno visto con quello che hanno creduto di vedere, ciò che hanno sentito con quello che già ritenevano di sapere, o ciò che ha fatto una persona con quello che ha fatto un’altra. Questi falsi ricordi possono essere causati da errori di memoria relativi al monitoraggio della fonte d’informazione, in quanto, dal momento che l’informazione e la sua fonte possono essere ricordate in maniera separata, ci si può ricordare della suddetta informazione ma non della fonte dalla quale l’abbiamo appresa, finendo per attribuirla ad una fonte sbagliata (che ha trattato lo stesso tema, addirittura sostenendo il contrario); per esempio possiamo credere erroneamente che sia l’Organizzazione Mondiale della Sanità ad allertare sui rischi dei vaccini.

Abbiamo visto come il fenomeno della resistenza alle smentite metta seriamente alla prova la premessa secondo cui l’uomo è fondamentalmente un essere razionale. D’altronde, dal momento che la nostra memoria opera secondo dei processi ricostruttivi degli eventi, non possiamo riporvi una fiducia incondizionata (si veda Query, 4, 30-34). Ma se le informazioni di cui disponiamo si rivelano, per qualsiasi ragione, imprecise o sbagliate, perché ci ostiniamo a credervi? Per rispondere a questa domanda possono essere chiamati in causa diversi meccanismi o bias cognitivi. Anzitutto, rispetto alla complessità del mondo, risulta molto difficile per le persone abbandonare l’illusione del controllo. Per ridurre o quantomeno controllare l’incertezza, le persone cedono all’esigenza di ricercare chiarimenti e di conferire una spiegazione causale agli eventi, anche quando non vi sono dei nessi di causazione evidenti fra un evento A ed un evento B. Così, si possono giustificare schemi di causalità inesistenti, facendo delle previsioni estreme con un ottimismo o pessimismo ingiustificati. Si pensi, ad esempio, alla storia della maledizione della copertina di Sports Illustrated[8], secondo la quale l’atleta o la squadra sportiva che conquistano la copertina del celebre magazine sarebbero poi destinati all’insuccesso, che si può manifestare con una serie di cattivi risultati, infortuni, e così via. Si tratta di una leggenda metropolitana che può essere spiegata dalla cosiddetta regressione verso la media; difatti, a finire sulla copertina è in realtà chi ha conseguito delle prestazioni del tutto eccezionali e che, in quanto tali, saranno prevedibilmente seguite da performance “peggiori”, cioè che si avvicineranno alla media.

La ricerca di una causalità sottostante avviene specialmente rispetto ad avvenimenti insoliti o negativi, per evitare in qualche modo che si ripetano. Ed in quei casi in cui le informazioni a disposizione circa un evento sono ambigue, contraddittorie o non immediatamente decifrabili, il ricorso alle spiegazioni fornite dai miti e alle leggende popolari diventa particolarmente rassicurante. Appellarsi alle proprie conoscenze pregresse e pregiudiziali permette di dare un senso, anche se imperfetto o incompleto, a degli eventi che sarebbero altrimenti di difficile comprensione. Si pensi all’aura di mistero che circonda un disturbo assai complesso come l’autismo, rispetto alla cui reale eziologia la comunità scientifica non è giunta ancora alla formulazione di teorie univoche e definitive. Ciò ha dato ampio spazio nel corso del tempo alla proliferazione di ipotesi estremamente eterogenee quanto scientificamente infondate sulle sue cause, come l’ampiamente smentita credenza secondo la quale i vaccini abbiano un ruolo in merito. Nonostante le ripetute smentite da più parti e gli accorati appelli a partecipare ai programmi di immunizzazione preventiva, questa falsa credenza ha tutt’oggi ancora un largo seguito in parte perché, in assenza di una spiegazione causale alternativa soddisfacente, le persone tendono a ripiegare sulla spiegazione fornita dal mito, per quanto evidentemente errata. Il problema risiede nel fatto che quando una persona apprende un’informazione scorretta, costruisce una sorta di modello mentale, ovvero una storia radicata nella propria mente, con il mito che ne fornisce una spiegazione. Perciò, quando si tenta di comunicarle che ciò in cui crede è falso, risulta difficile per la persona sorreggere la validità di un modello con un “buco”, una lacuna mentale. Così, in assenza di una spiegazione migliore, si finisce per preferire un modello pre-esistente ed errato rispetto ad uno corretto ma incompleto. La questione diventa ancor più complessa se si considera che, una volta che abbiamo una teoria, una certa visione del mondo che in qualche modo ci soddisfa e in cui crediamo, tendiamo sistematicamente ad esaminare i fatti attraverso di essa e a ricercare puntualmente conferme a questa teoria. Come ci ricorda un antico detto: due terzi di quello che vediamo è dietro i nostri occhi. Sarà la nostra visione del mondo a determinare quindi ciò che osserviamo, tralasciando tutto il resto che in qualche modo risulta non conforme rispetto alle nostre convinzioni.

Per elaborare le informazioni velocemente ricorriamo ad una serie di euristiche, ovvero a delle scorciatoie mentali che consentono un notevole risparmio delle nostre limitate risorse cognitive. Tali meccanismi cognitivi si caratterizzano per la loro parziale automaticità, per cui si è spesso inconsapevoli di metterli in atto, nonché per la loro profonda radicazione, in quanto modificarli richiede volontà, impegno e tempo, proprio perché si tratta di schemi di ragionamento interiorizzati. Ad esempio, ogni qual volta si è posti di fronte ad una nuova informazione, ci si chiede come questa si incastri con ciò in cui crediamo. Se l’informazione non risulta coerente con la nostra visione del mondo, e se non siamo motivati ad un’analisi approfondita della questione, essa tenderà a venir percepita come sbagliata proprio in quanto incoerente, ed avrà altresì una minore probabilità di essere accettata come vera. Il paragone non viene operato solo rispetto a se stessi, ma anche rispetto a quello che si pensa credano le altre persone. Essendo difatti l’uniformità al proprio gruppo di riferimento una pressione molto forte per l’uomo, l’informazione in questione verrà giudicata tanto più valida quanto più si avvicina alla voce del coro.

Le possibili strategie correttive

Contrastare efficacemente la disinformazione è un compito tutt’altro che semplice. Una convinzione assai diffusa quanto sbagliata è che, per rimuovere l’influenza dei miti, basti riempire la testa della gente con il maggior numero possibile di informazioni. Difatti, secondo il “modello del deficit di informazione”, il nostro cervello non sarebbe altro che una sorta di disco rigido che accumula dati. Di conseguenza, le convinzioni errate delle persone sarebbero dovute unicamente ad una mancanza di informazioni corrette che, se opportunamente comunicate, garantirebbero la rimozione dell’influenza della falsa credenza in questione. Tuttavia, quest’approccio si è rivelato evidentemente limitato dal momento che numerosi studi dimostrano come, una volta che l’informazione sbagliata è stata immagazzinata, non si può semplicemente spazzarla via. Quindi, per sfatare miti e false credenze e trasmettere delle informazioni in modo efficace bisogna prestare attenzione non solo a cosa pensano le persone ma anche a come pensano, comprendendo come queste elaborano le informazioni, nonché come le modificano in ragione delle conoscenze pre-esistenti e della propria visione del mondo.

Ad oggi, le strategie che si sono rivelate più efficaci in materia di demistificazione sono essenzialmente tre. La prima implica l’utilizzo di espliciti avvertimenti (del tipo: “attenzione, potresti essere tratto in inganno”), che segnalino quindi la presentazione imminente di un’informazione scorretta. Mettere in guardia rispetto all’infondatezza dell’informazione che si sta per analizzare consente infatti di indurre un temporaneo stato di scetticismo che permette di discriminare più efficacemente ciò che è vero da ciò che è falso. Tuttavia, questi avvertimenti dovrebbero essere forniti prima dell’informazione fallace in questione, cosa non sempre realizzabile al di fuori del laboratorio, nella vita quotidiana. Alternativamente, ripetere più volte che l’informazione è sbagliata può talvolta ridurre la fiducia che le persone ripongono in essa. Anche questa è tuttavia un’operazione assai delicata perché esagerare nelle contro-argomentazioni, fornendo troppi dati o spiegazioni esageratamente complicate, può talvolta sortire l’effetto opposto e rafforzare le credenze erronee iniziali. Un approccio forse più efficace consiste nel fornire una spiegazione alternativa alle lacune lasciate dal mito, dando altresì ragione del motivo per il quale l’informazione sbagliata sia stata fornita in prima istanza. Tuttavia, anche questo approccio non è sempre praticabile in quanto vi sono eventi che non hanno una spiegazione causale evidente ed univoca.

In mancanza di una strategia certa che possa assicurare l’eradicazione dell’influenza della disinformazione, il principio che dovrebbe comunque guidare l’opera di demistificazione è senza dubbio quello di non rendere le cose peggiori, evitando i vari possibili effetti negativi della comunicazione. Ad esempio, un buon comunicatore sa che i suoi tentativi di correggere credenze profondamente radicate, per quanto ben intenzionati e formalmente corretti, sono destinati a fallire fin dall’inizio se comincia con l’informare le persone che sono in errore. La conseguenza più probabile di una simile condotta sarà un atteggiamento difensivo e di chiusura di fronte alle argomentazioni proposte. Una strategia più promettente nel far recedere qualcuno dalle sue convinzioni risiede invece nel presentare, ove possibile, il messaggio che si vuole trasmettere cercando di renderlo meno minaccioso rispetto alla visione del mondo degli interlocutori ed abbinandolo a momenti di cosiddetta auto-affermazione. In tal modo, questi avranno la possibilità di esprimere la propria visione del mondo e di sentirsi a proprio agio con essa, cosa che farà apparire anche la presentazione di contro-argomentazioni come meno minacciosa. Uno studio di Cohen e colleghi ha dimostrato come la resistenza ad accettare visioni diverse dalle proprie da parte di persone con opinioni politiche molto radicate possa essere allentata allorquando si offre loro l’opportunità di spiegare perché una determinata caratteristica personale o comportamento è così importante per loro. Così, le persone non sentiranno la propria immagine di sé così intaccata e saranno più ricettive verso contro-argomenti che altrimenti potrebbero minacciare e paradossalmente rafforzare le loro credenze.

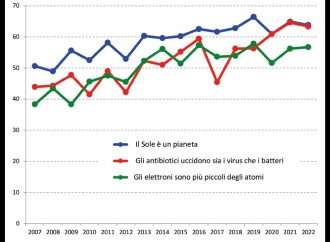

Oltre alla necessità di prendere in considerazione la visione del mondo della persona e le sue convinzioni più radicate, un’efficace demistificazione richiede di enfatizzare unicamente i fatti che si vogliono comunicare ed evitare di menzionare il mito mentre si cerca di correggerlo, evitando il cosiddetto “ritorno di fiamma di familiarità” ingenerato dall’inutile ripetizione dei miti, che non fa che renderli più familiari ed immediatamente accessibili nella mente delle persone. Laddove questo non fosse possibile, ci si dovrebbe quantomeno focalizzare prioritariamente sui fatti piuttosto che sul mito, comunicandoli nel titolo e rafforzandoli via via nel corso del testo, insieme alle spiegazioni di come il mito possa trarre in inganno. Altresì, è bene preferire un linguaggio semplice, non sensazionalistico e che preveda frasi brevi, dirette, nonché accompagnate, ove possibile, da grafici che illustrino meglio i vari punti.

La varietà di queste raccomandazioni fa intendere come l’opera di demistificazione sia una sfida complessa, ma senza dubbio necessaria dal momento che le società democratiche debbono basare le loro decisioni su informazioni accurate. «Guai – scriveva nel 1982 il fisico Giuliano Toraldo di Francia – se limitandoci a soddisfare curiosità abbastanza superficiali non riusciamo a integrare la scienza nel vivo del tessuto culturale della società italiana»[9].

Note

6) Detroit’s WDIV TV News, November, 1991

9) Vincenzo Barone, “Chi uccide i virus e i batteri?”, Il Sole 24Ore – Domenica, 09/08/2015, pag. 22.

Riferimenti bibliografici

- Cohen, G. L., Sherman, D. K., Bastardi, A., Hsu, L., & McGoey, M. (2007). Bridging the partisan divide: Self-affirmation reduces ideological closed-mindedness and inflexibility in negotiation. Journal of Personality and Social Psychology, 93(3), 415-430.

- Cook, J., Ecker, U. & Lewandowsky, S. (2015). Misinformation and how to correct it. Emerging Trends in the Social and Behavioral Sciences: An Interdisciplinary, Searchable, and Linkable Resource. 1–17.

- Cooper, J. (2007). Cognitive dissonance: Fifty years of a classic theory. London: SAGE.

- Cubelli, R. & Della Sala, S. (2007). False testimonianze. Mente

- Cubelli, R. & Della Sala, S. (2009). Memories as re-presentations. Cortex, 45, 688-692.

- Glantz, S. A., Barnes, D. E., Bero, L., Hanauer, P., & Slade, J. (1995). Looking through a keyhole at the tobacco industry: The Brown and Williamson documents. JAMA, 274(3), 219-224.

- Gornall, J. (2015). Sugar: Spinning a web of influence. BMJ, 350, h231.

- Gornall, J. (2015). Sugar’s web of influence 2: Biasing the science. BMJ, 350, h215.

- Peters, K., Kashima, Y., & Clark, A. (2009). Talking about others: Emotionality and the dissemination of social information. European Journal of Social Psychology, 39(2), 207-222.

- Rapp, D. N., & Braasch, J. L. (Eds.) (2014). Processing inaccurate information: Theoretical and applied perspectives from cognitive science and the educational sciences. Cambridge: MIT Press.

- Seifert, C. M. (2002). The continued influence of misinformation in memory: What makes a correction effective? Psychology of Learning and Motivation, 41, 265-294.