Leggendo o ascoltando questo frammento sembra di essere presenti a una conferenza del CICAP, ma proseguendo con le due frasi successive dell’interlocutore si scopre che l’argomento di fondo è abbastanza lontano da quelli trattati dal nostro comitato: «Da questa prospettiva si ha un’idea molto diversa di cosa faccia la tecnologia. Allo Stanford Persuasive Technology Lab studiavamo proprio questo. Come sfruttare ciò che sappiamo di cosa persuada la gente e integrarlo nella tecnologia.»

Questo frammento di intervista è tratto dal recente documentario The Social Dilemma[1] disponibile sulla piattaforma Netflix; a parlare è Tristan Harris[2], la cosa più vicina a una coscienza della Silicon Valley secondo un articolo del The Atlantic[3] ed ex Design Ethicist (esperto di etica del Design) di Google.

Il documentario del regista Jeff Orlowski[4] si basa sulle testimonianze di ex collaboratori e persone di spicco di grandi aziende informatiche come ad esempio Google, Facebook e Instagram, e approfondisce il tema dell’invasività e degli effetti dei social media nella nostra società.

Il tema di fondo è che i social media sono strumenti informatici fatti evolvere dagli sviluppatori nel corso del tempo attraverso l’implementazione dei cosiddetti algoritmi i quali - e questo è l’allarme lanciato dal documentario - avendo l’obiettivo di trattenere gli utenti il maggior tempo possibile nell’uso del dispositivo, finiscono non solo per creare dipendenza negli utenti stessi ma favoriscono una serie di altri effetti collaterali negativi per l’essere umano e per la società in generale.

Il termine algoritmo deriva dalla trascrizione latina del nome al-Khwarizmi[5], matematico persiano vissuto nel IX secolo d.C., che è stato uno dei primi ad aver fatto riferimento a questo concetto.

L’algoritmo è un procedimento che consente di risolvere una classe di problemi attraverso un numero finito di passi elementari, chiari e non ambigui. Sembrerebbe una cosa molto complessa ma possiamo pensare al concetto di algoritmo come alla ricetta per cucinare il nostro cibo preferito: la ricetta descrive la sequenza delle istruzioni che il cuoco deve seguire per ottenere un risultato a partire da alcuni elementi dati. In altre parole, dati degli elementi di partenza e un obiettivo finale, l’algoritmo descrive i passi per raggiungere quell’obiettivo.

Da questo semplice concetto, la matematica ha saputo creare e formalizzare dei metodi via via sempre più complessi per risolvere classi di problemi sempre più intricati. Parallelamente allo sviluppo dei computer e di internet, le cose si sono ancora più complicate quando si è fatta strada nell’informatica la disciplina dell’Intelligenza Artificiale che al giorno d’oggi consente di creare algoritmi in grado di apprendere e migliorare in autonomia le proprie prestazioni. Questi algoritmi con il passare del tempo sono in grado di automodificarsi al di fuori del controllo umano raggiungendo in maniera sempre più precisa gli obiettivi prefissati, anche sfruttando tutte le falle della nostra mente in maniera cinicamente scientifica, così come anticipava Tristan Harris nell’ultimo frammento dell’intervista.

Nel caso dei social media gli elementi di partenza siamo tutti noi esseri umani con i dispositivi informatici che utilizziamo, ma qual è l’obiettivo primario per cui gli algoritmi sono sviluppati?

Massimizzare il coinvolgimento (engagement) in termini di tempo delle persone nell’uso dei dispositivi stessi, principalmente per profitto, fini commerciali e vendita in senso lato, includendo nella vendita anche prodotti come messaggi e proposte politiche.

Al di là del documentario, il tema che porta avanti da diversi anni Tristan Harris è ben riassunto nella presentazione[6] che creò nel 2013 quando lavorava per Google dal titolo Appello a minimizzare la distrazione e al rispetto dell’attenzione dell’utente. Harris sostiene, insieme a tanti altri esperti fuoriusciti dalle grandi compagnie informatiche moderne, che non sono etiche le finalità per cui gli algoritmi sono sviluppati. Gli obiettivi che perseguono non solo non considerano il benessere delle persone ma hanno degli importanti effetti collaterali negativi per la società in generale, come ad esempio:

- far prevalere le fake news sulle verità, perché le fake news hanno più capacità di coinvolgimento

- favorire e far crescere i nuovi sistemi di credenza su un terreno che non è affatto paragonabile, in termini di velocità e quantità, a ciò che poteva avvenire durante l’epoca pre-internet

- consentire molto più facilmente e capillarmente la manipolazione dell’opinione pubblica (si pensi alle elezioni politiche)

- addirittura incanalare l’opinione pubblica verso strade suggerite dagli algoritmi di intelligenza artificiale sui quali non abbiamo un controllo diretto dal momento che evolvono in autonomia

Per sensibilizzare la collettività anche su questi temi Harris ha fondato nel 2018 il Center for Human Technology[7] utilizzando inoltre un podcast[8] attraverso il quale è possibile ascoltare interviste molto interessanti, fra le quali una recente in particolare ha catturato la mia attenzione: Il mondo secondo Q[9][10]. In questo episodio Harris intervista Travis View, ricercatore e scrittore che analizza e investiga la teoria della cospirazione che risponde al nome di QAnon; Travis View gestisce anche un podcast interamente dedicato all’argomento. Per chi non conoscesse QAnon, basti sapere che i suoi sostenitori affermano che esiste un complotto universale fra i potenti del mondo, impegnati in rituali satanici che prevedono il sacrificio di milioni di bambini e che soprattutto a contrastare questo complotto sia, nel segreto più assoluto, il presidente americano Donald Trump. Potrebbe sembrare la trama di uno sgangherato film di serie Z ma purtroppo il fenomeno ha assunto ormai una dimensione a livello sociale molto preoccupante. Per approfondimenti sul tema suggerisco gli spunti di Massimo Polidoro attraverso il suo libro[11] e i suoi ottimi video[12][13].

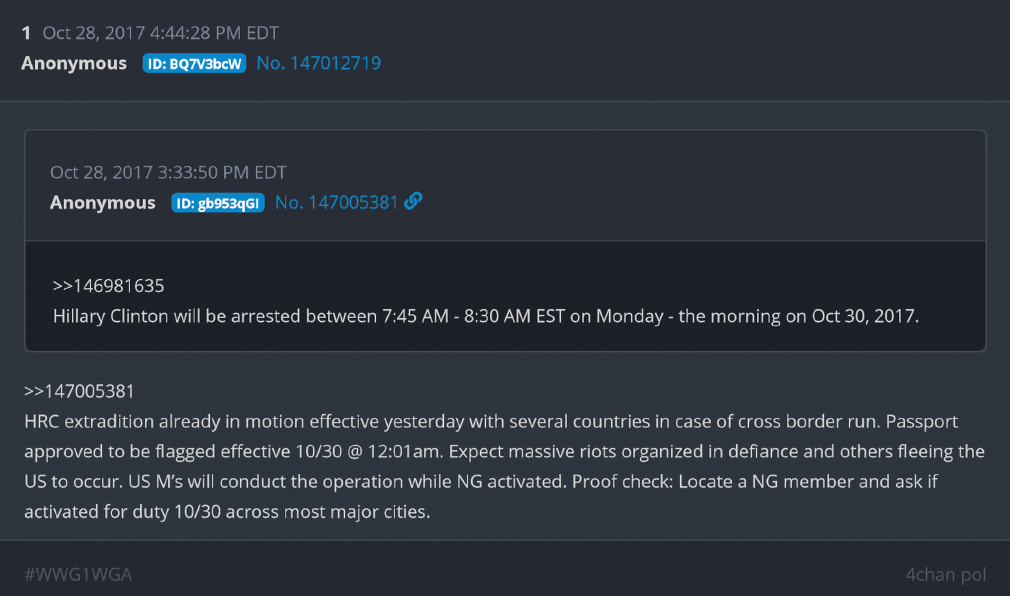

Alla base di questo sistema di credenze ci sarebbe un personaggio anonimo che si firma con la lettera Q (da qui la sigla QAnon) che cominciò a inviare nell’ottobre del 2017 messaggi e indizi criptati su internet veicolando contenuti di tipo politico. Il primo, del 28 ottobre, ad esempio affermava che Hillary Clinton sarebbe stata presto arrestata ma tutto ciò non è mai avvenuto. Pur rimanendo dapprima un fenomeno confinato agli USA, sempre più persone si sono fatte coinvolgere da questo virus mentale che proprio durante il primo periodo della pandemia da COVID-19 durante la primavera del 2020, è esploso non solo negli Stati Uniti ma è approdato anche qui in Europa. Percorrendo l’intervista di Tristan Harris a Travis View è possibile cogliere molti aspetti veramente interessanti della questione, che evidenziano -tra le altre cose- in QAnon il modus operandi dei culti, meccanismi di cold-reading adoperati da chi sta dietro la firma Q e la tecnica di fornire indizi da decodificare per coinvolgere i sostenitori in maniera interattiva.

Certamente tutto ciò non sarebbe potuto accadere in epoca pre-internet e inoltre il fenomeno è assolutamente stato favorito dagli algoritmi che, come evidenziato precedentemente, massimizzano il coinvolgimento degli utenti non distinguendo tra vero o falso, salutare o pericoloso, saggio o radicalizzante.

Comprendere le modalità della nascita di un sistema di credenze così assurdo ma allo stesso tempo così complesso e potenzialmente pericoloso come QAnon dovrebbe realmente renderci tutti più consapevoli di quanto sia importante lavorare sull’etica nella progettazione dei moderni sistemi informatici, strumenti sì tanto potenti e proprio per questo potenzialmente distruttivi nei confronti dell’essere umano.